Un raport realizat de Expert Forum despre manipularea online în Republica Moldova dezvăluie o realitate alarmantă. De la conturile false generate prin inteligența artificială la rețelele coordonate care creează iluzia unui comportament organic de postare, raportul prezintă anatomia completă a unui război informațional înaintea alegerilor parlamentare din 28 septembrie.

În spatele acestei manipulări se află o campanie sistematică concepută pentru a crea anxietate constantă anti-UE, despre amenințări externe, război și pierderea suveranității. Analiza relevă că mesajele bazate pe frică domină peisajul narativ, conturile coordonate răspândind povești alarmiste despre integrarea forțată și controlul străin, arată autorii.

Raportul intitulat „Analiza comportamentului inautentic coordonat în Moldova: 23 de zile înainte de alegeri” se bazează pe analiza a 3.392 de videoclipuri, 36.338 de comentarii și 100 de conturi false identificate.

Sursa: Expert Forum

Alegătorii indeciși sunt luați la țintă

Cazul României ne-a arătat efectul de domino al manipulării digitale în perioadele electorale. Observăm peste tot în lume o creștere dramatică a „late deciding voters” – alegători care își iau decizia în ultimul moment, influențați de ceea ce văd pe ecrane în ultimele săptămâni. Bătaia pentru atenția oamenilor și lupta de a ocupa cât mai mult din timpul petrecut în fața unui ecran nu mai este doar o strategie de marketing politic, vedem de-a dreptul o cursă pentru controlul atenției votanților care petrec mult timp online, se menționează în raport.

În acest context geopolitic tensionat, conținutul care circulă cu o lună înainte de alegeri devine o unealtă extrem de eficientă de persuasiune și manipulare a percepției publice.

Experiența României, cu creșterea fulgerătoare a unui candidat presupus independent de extremă dreapta prin conturi inautentice, deci printr-o campanie orchestrată digital, ne demonstrează că nu putem subestima puterea acestor instrumente de influențare, chiar dacă nu trebuie să minimalizăm nici importanța factorilor socio-economici care creează terenul fertil pentru aceste mesaje.

Raportul a analizat ultimele 30 de zile de conținut trending din Republica Moldova, pentru a înțelege cum arată războiul informațional în timp real.

Trending în definiția acestei analize înseamnă conținut în top 100 pe hashtag-urile monitorizate, în general cu peste 5.000 de vizualizări. CIB (Coordinated Inauthentic Behavior) se referă la conținut inautentic, unde coordonarea poate fi observată în temele urmărite, videoclipurile reciclate și modelele de distribuție, fără să fie neapărat identică la nivel de detalii tehnice.

Evoluția amenințării: De la ferme de troli, la AI

Ceea ce observăm astăzi e fundamental diferit de campaniile clasice de dezinformare, arată autorii raportului. Aceste campanii tradiționale sunt din ce în ce mai rare și înlocuite cu ceva mult mai facil. AI-ul. Tehnologiile precum ChatGPT au accelerat dramatic poluarea feed-urilor cu conținut artificial care imită comportamentul uman.

Analiza a dezvăluit o concentrare masivă pe termeni politici regionali care reflectă direct presiunile geopolitice.

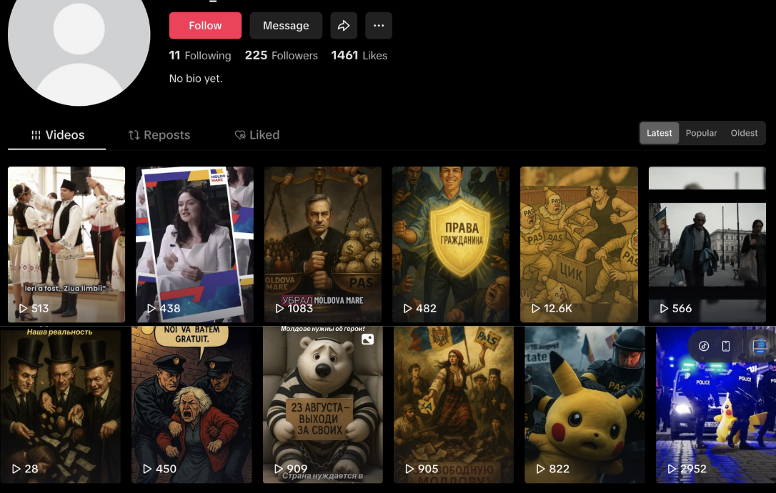

Un trend relevant este folosirea conturilor mici, cu câteva sute de urmăritori, care au câte 1-2 videoclipuri cu un număr halucinant de vizualizări – 30.000, 100.000 – complet disproporționat față de mărimea contului și restul interacțiunilor.

Aceste conturi artificiale sunt mult mai ușor de creat decât fermele tradiționale de troli, necesitând investiții minime pentru rezultate gigant. AI-ul poate genera în câteva minute profiluri complete, poze realiste, biografii credibile, conținut variat care ar fi necesitat săptămâni de muncă manuală.

Pericolul pentru social media este că aceste conturi devin din ce în ce mai greu de detectat, mimând comportamentul uman și evoluând constant pentru a evita sistemele de detecție automatizată.

În contextul electoral din Moldova, această tehnologie transformă dezinformarea dintr-o tactică în instrument de război cu potențial de a destabiliza fluxul informațional, mai ales pe măsură ce ne apropiem de ziua votului.

Tactica “Lover Boy”, varianta “Lover Woman”

O tehnică identificată în câmpul digital din Moldova este o strategie psihologică clasică pentru profilele/avatarele false care exploatează atracția vizuală pentru a crește interesul pentru mesajele politice.

Aceste conturi folosesc masiv poze generice (stock) sau imagini furate/reciclate de la persoane reale, conturi cumpărate de la utilizatori autentici, sau alte tactici de acaparare a identității digitale.

Rezultatul este o armată de conturi cu poze de femei stereotipic frumoase și atractive (conform standardelor convenționale) care promovează comportament de tip CIB prin propagandă politică coordonată.

Sursa: Expert Forum / TikTok

Această tactică nu este aleatorie – ea exploatează prejudecăți cognitive fundamentale. În contextul electoral din Moldova, această manipulare devine o armă de război informațional: propagandiștii știu că un mesaj anti-UE sau pro-rus va fi primit mai favorabil dacă vine de la o “tânără moldoveancă frumoasă” decât de la un cont anonim sau masculin.

Diviziunea muncii digitale

Analiza a identificat o infrastructură cu diverse tipuri de conturi, fiecare având roluri specifice în ecosistemul de manipulare.

Conturile tip “fan accounts”(conturi care pretind ca sunt urmăritori reali şi fani ai anumitor subiecte, cele mai populare conturi reale sunt chiar cele de fani ai vedetelor) postează exclusiv propagandă politică, în timp ce alte conturi au rolul de a lăsa comentarii copy-paste sau similare.

Practic, există o diviziune a muncii digitale: unele conturi servesc exclusiv ca “postaci” (creatori de conținut), altele se ocupă doar de comentarii, vizualizări și engagement artificial, iar altele funcționează doar pentru following și amplificare.

Multe dintre aceste conturi se suprapun și servesc mai multe funcții simultan.

Tehnica “Mătușa cu flori”

O altă tehnică relevantă, denumită “mătușa ta cu flori”, include conturi care creează avataruri tip personas, exact ca în marketingul comercial unde îți țintești audiența construind persoane fictive reprezentative pentru publicul țintă.

Scopul lor de a fi cât mai diversificate este evident: să fie cât mai ușor de a empatiza cu ele. Deși comportamentul lor este exclusiv propagandă politică, adaugă un plus de autenticitate când pui poze de profil cu flori pe care fiecare mătușă sau mamă est-europeană le-a avut la un moment dat.

Au fost identificate și conturi care fac referință la nume de celebrități. Poate pare comic că cineva se numește “Monika Bellucci”, dar această tehnică poate crea o familiaritate subconștientă a termenilor.

Sursa: Expert Forum / TikTok

De la anti-Sandu, la răspândirea fricii

Reprezentarea vizuală a cuvintelor din comentariile duplicate arată o concentrare pe termenii “pas”, “jos”, “maia”, “sandu” și “жос” (jos). Acești termeni apar cu frecvență mare în setul de 10.196 comentarii duplicate identificate din totalul de 36.338 comentarii analizate.

Sursa: Expert Forum

Analiza categoriilor de conținut relevă o strategie pe trei niveluri:

Subiect: Politicienii naționali se concentrează pe demonizarea Maiei Sandu și promovarea unor politicieni precum Victoria Furtună și Plahotniuc.

- Subiect: Politicienii locali exploatează tensiunile etnice cu Găgăuzia (în special în legătură cu condamnarea Evgheniei Guțul).

- Subiect: Știri promovează știri alarmiste despre amenințări externe, interferențe electorale, pericolul reprezentat de UE și confruntarea forțată a NATO cu Rusia.

- Subiect: Partidele politice conține în principal conținut anti-PAS.

Această distribuție combină atacurile personale cu exploatarea tensiunilor regionale și crearea unei panici generalizate.

Ce-i de făcut

Asemenea monitorizărilor din România, atenția trebuie concentrată urgent pe conturile cu comportament inautentic coordonat.

Paradoxul în care ne aflăm este că platformele invocă dreptul la libera exprimare pentru a proteja boții care atacă sistemul democratic într-un moment crucial pentru viitorul unei țări. Paradigma însă trebuie să se schimbe radical.

Conturile oficiale și reale ale actorilor politici trebuie protejate, dar intervenția urgentă trebuie să vizeze infrastructura de amplificare artificială, aceste rețele de conturi inautentice și “soldații” de viralizare care manipulează algoritmii. Doar prin demascarea și neutralizarea acestor sisteme putem păstra platformele ca reflectări autentice ale societății (asta dacă nu suntem mult departe de această lume ideală), nu ca instrumente de război hibrid împotriva democrației, conchide raportul.

T.D.